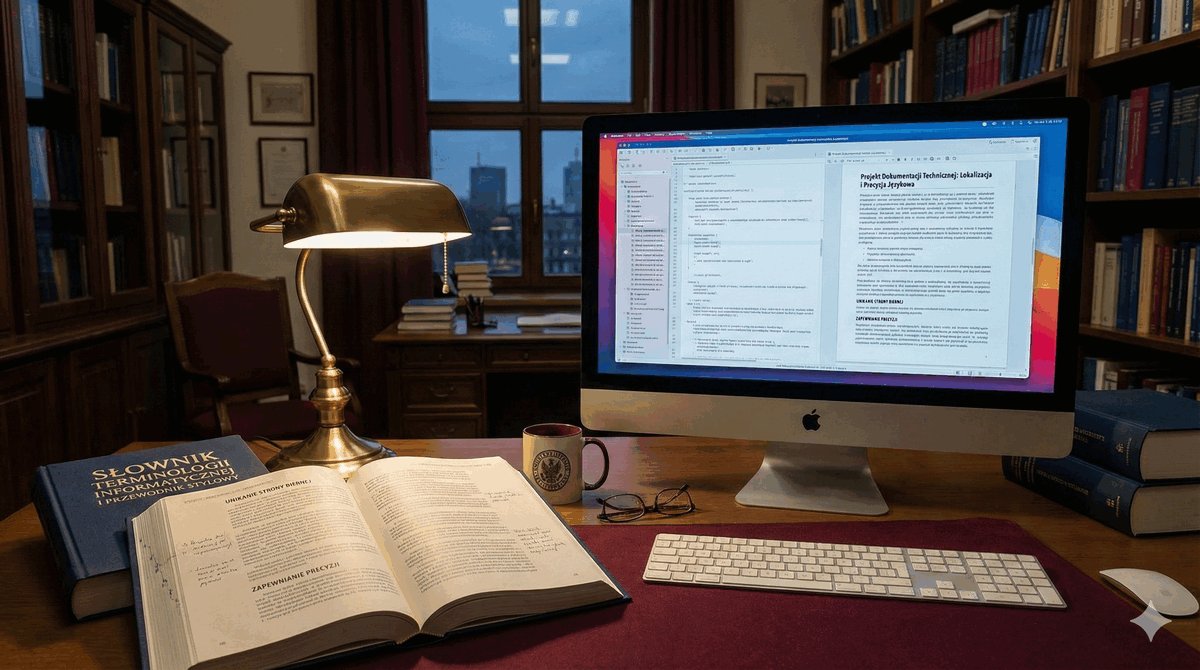

Wprowadzenie do komunikacji z modelami językowymi

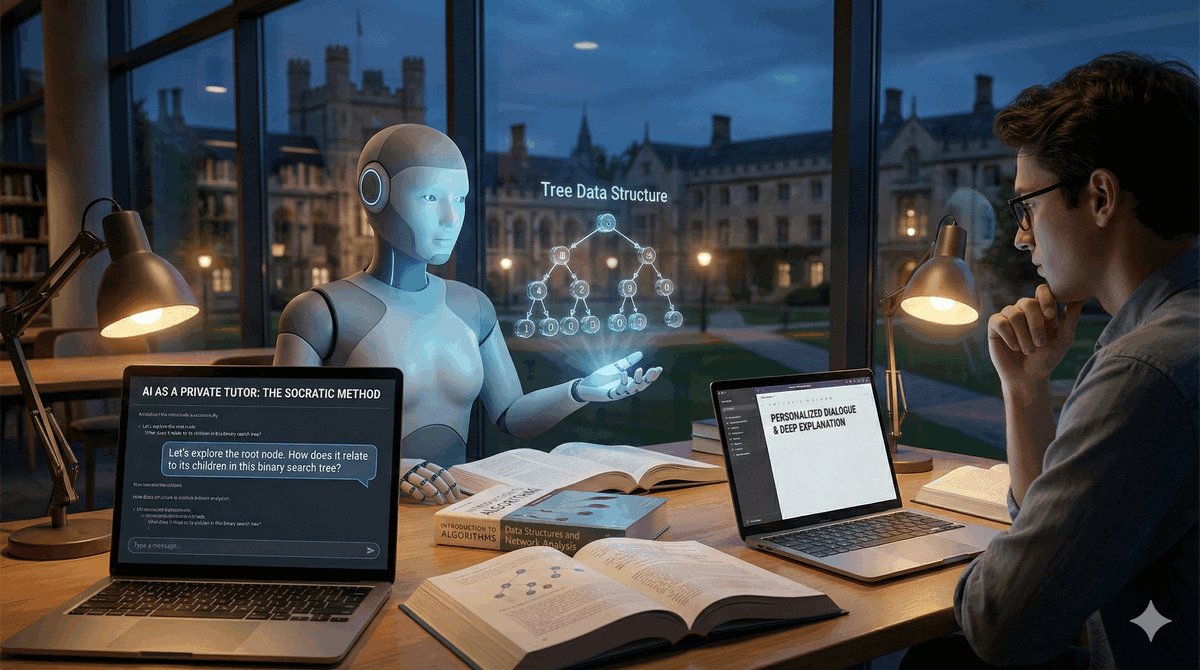

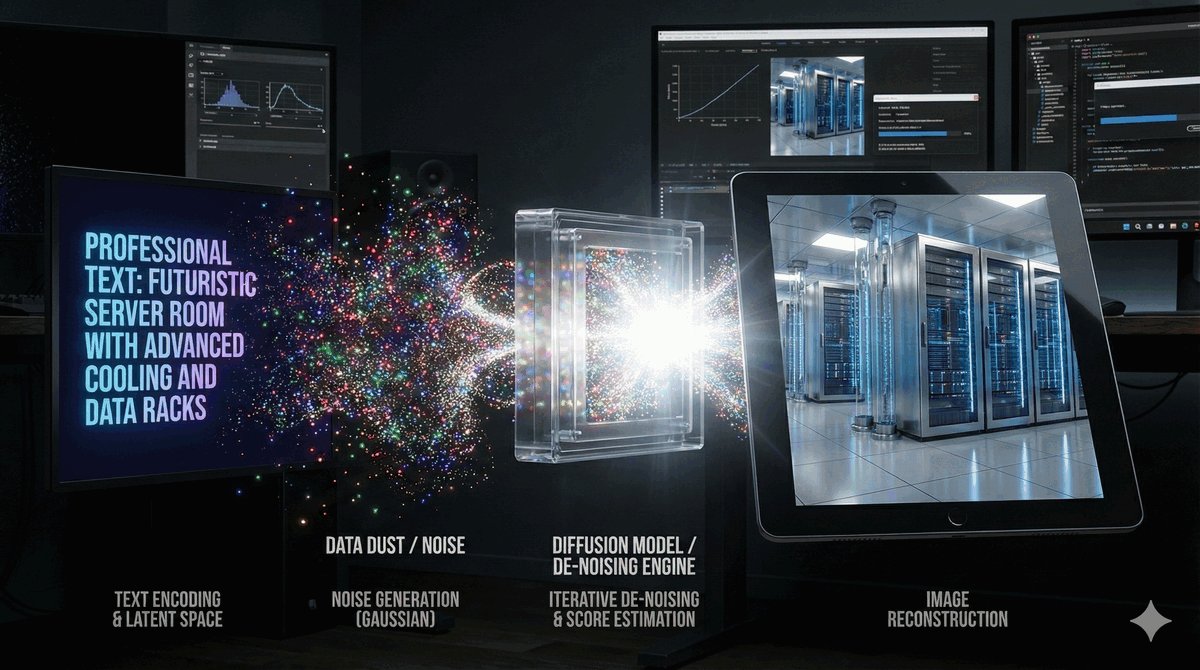

Witamy na wykładzie poświęconym fundamentom pracy z nowoczesną sztuczną inteligencją. Skupimy się na praktycznym aspekcie "rozmowy" z modelami takimi jak GPT, Claude czy Gemini.

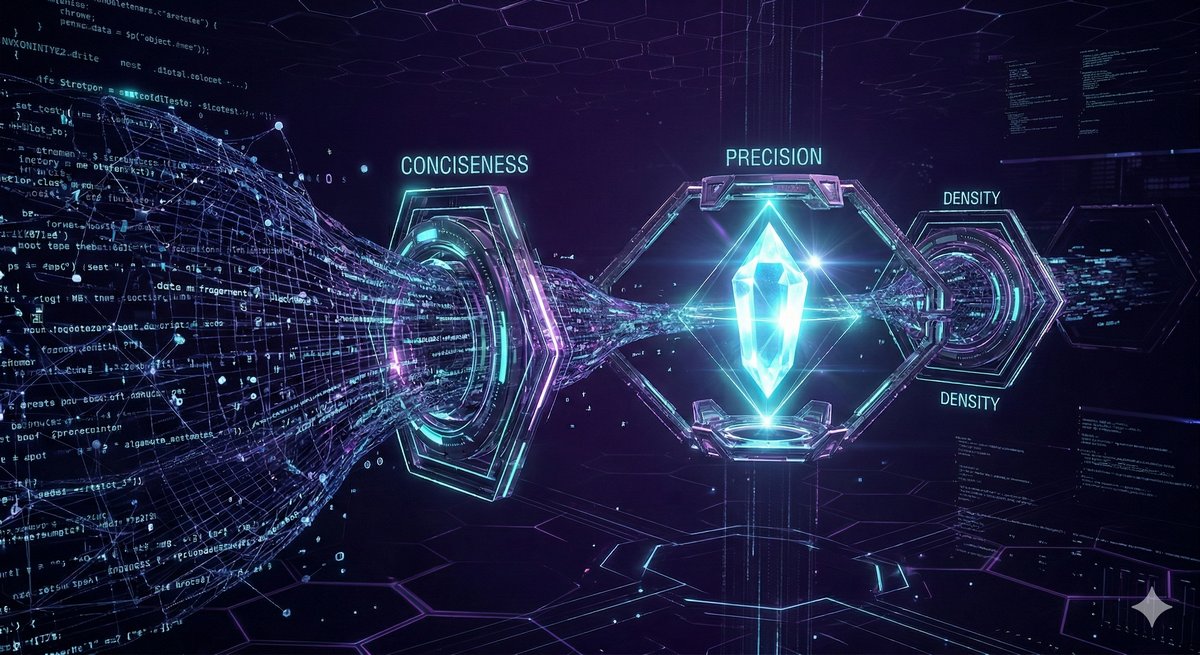

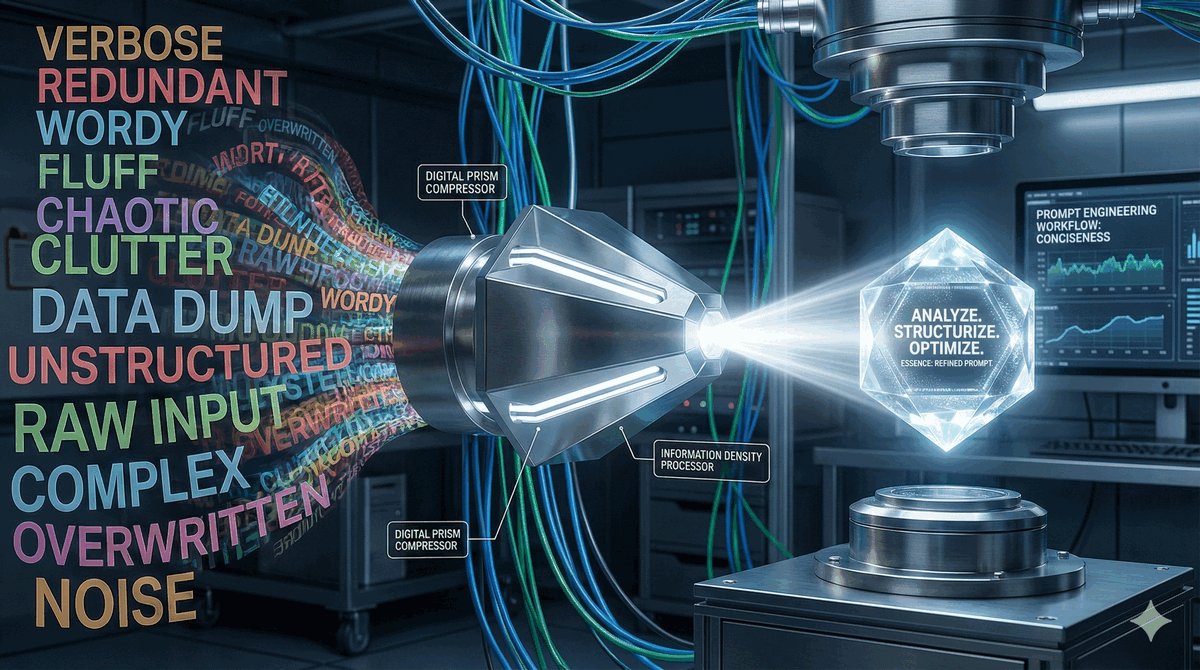

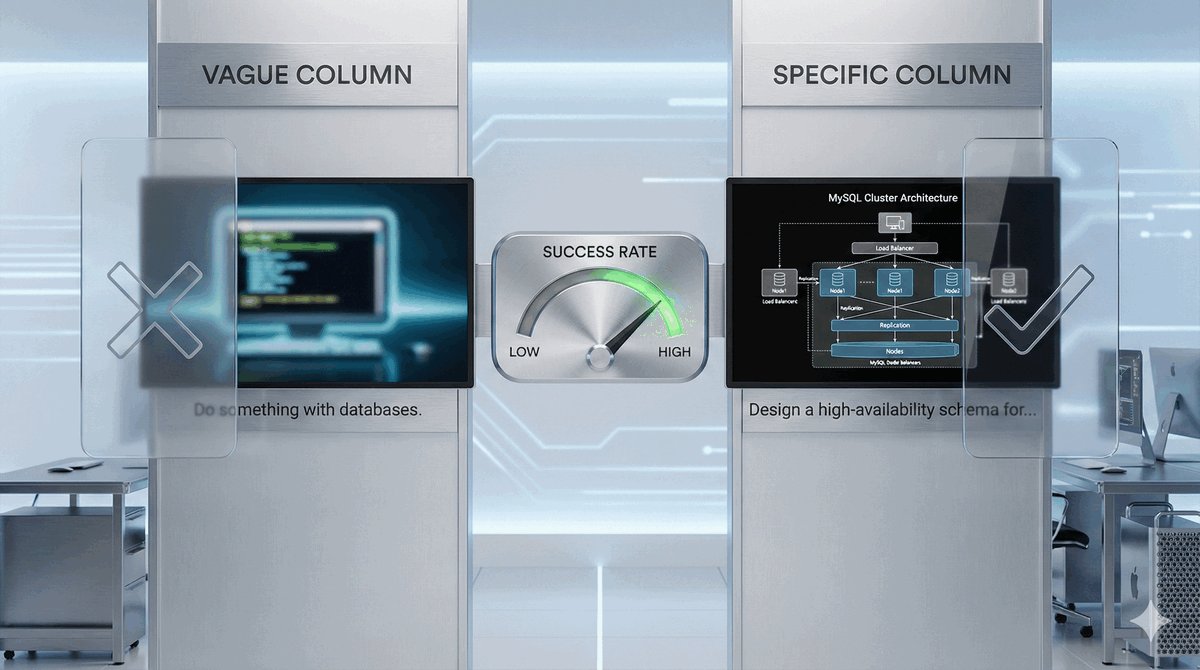

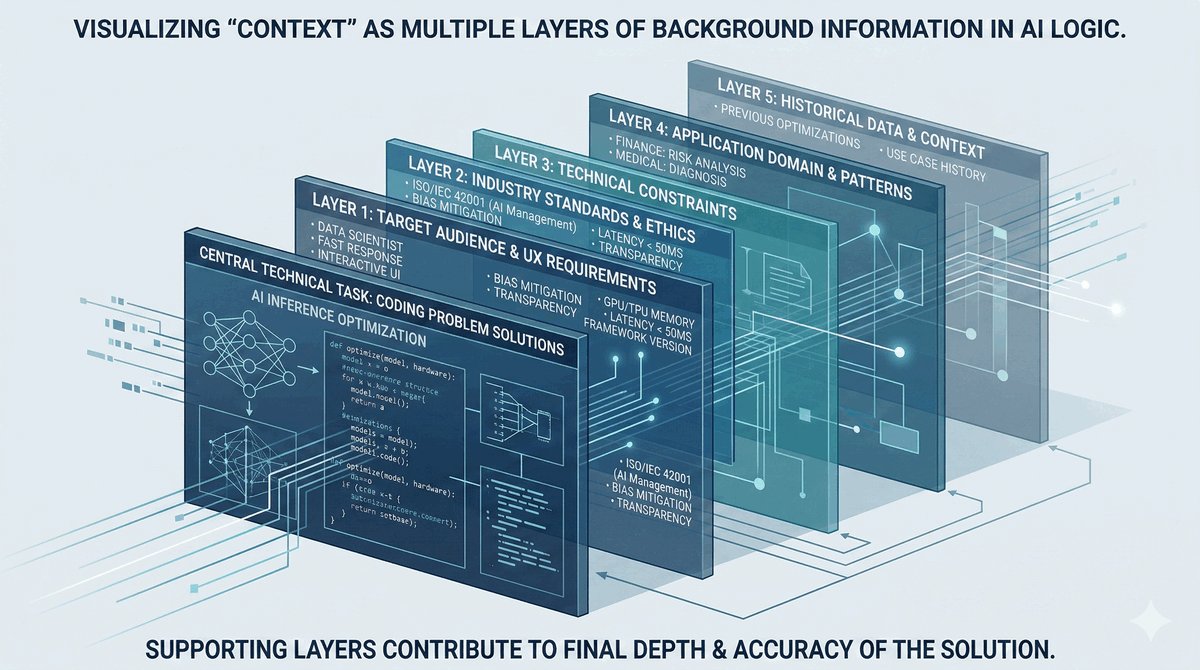

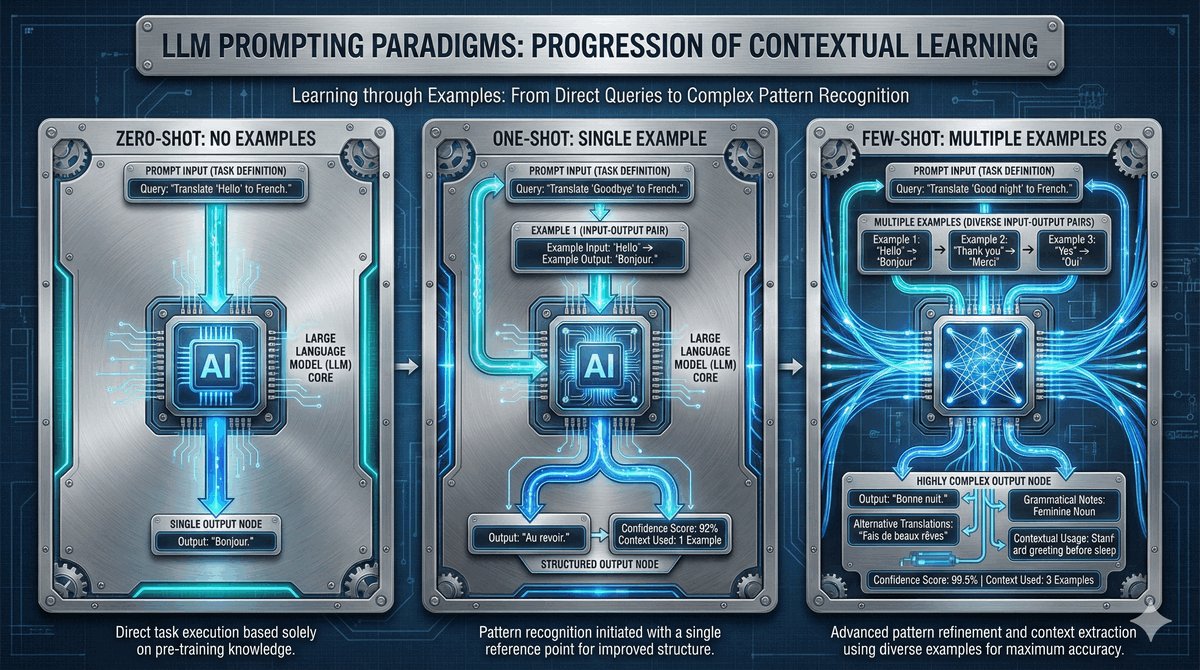

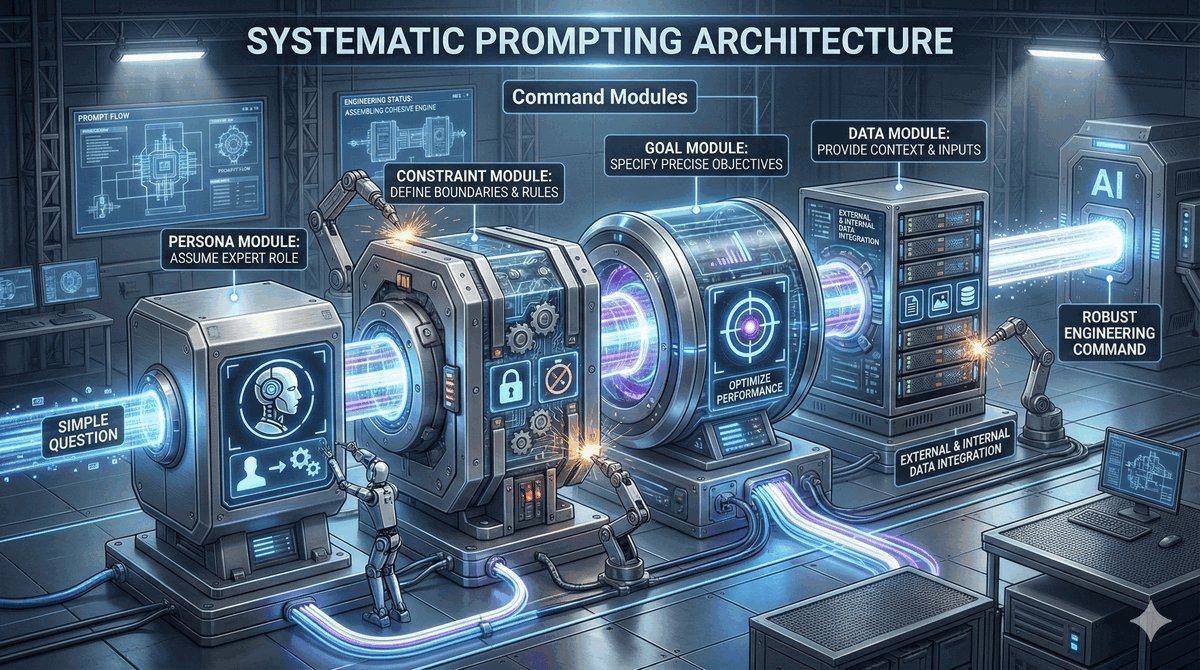

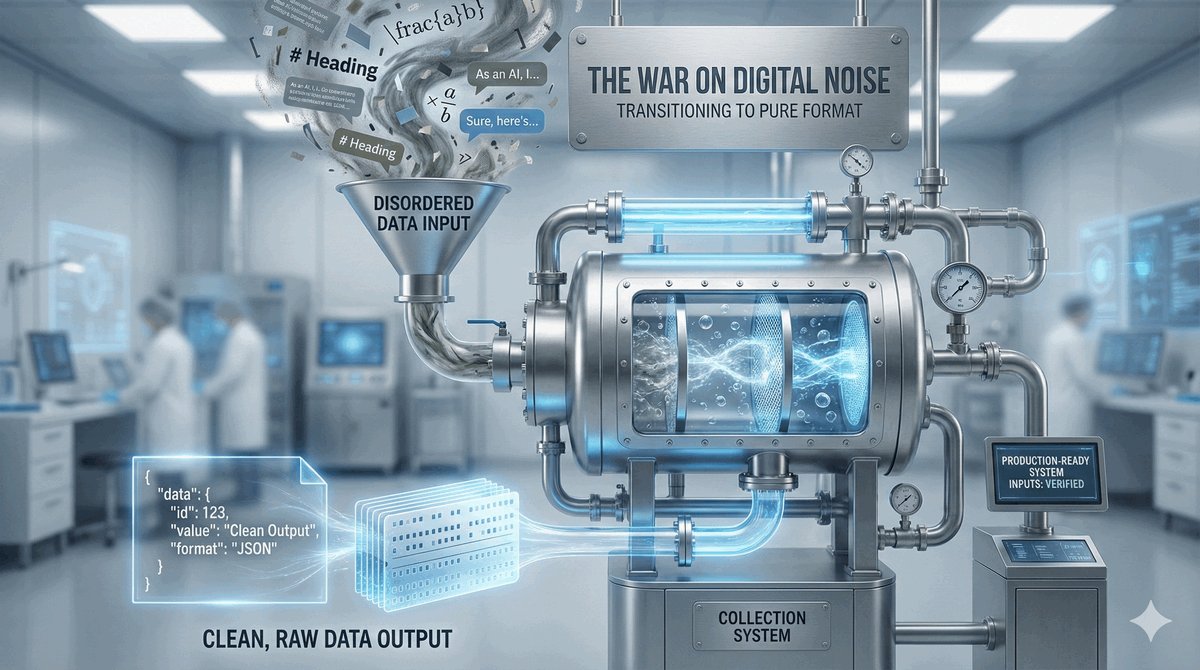

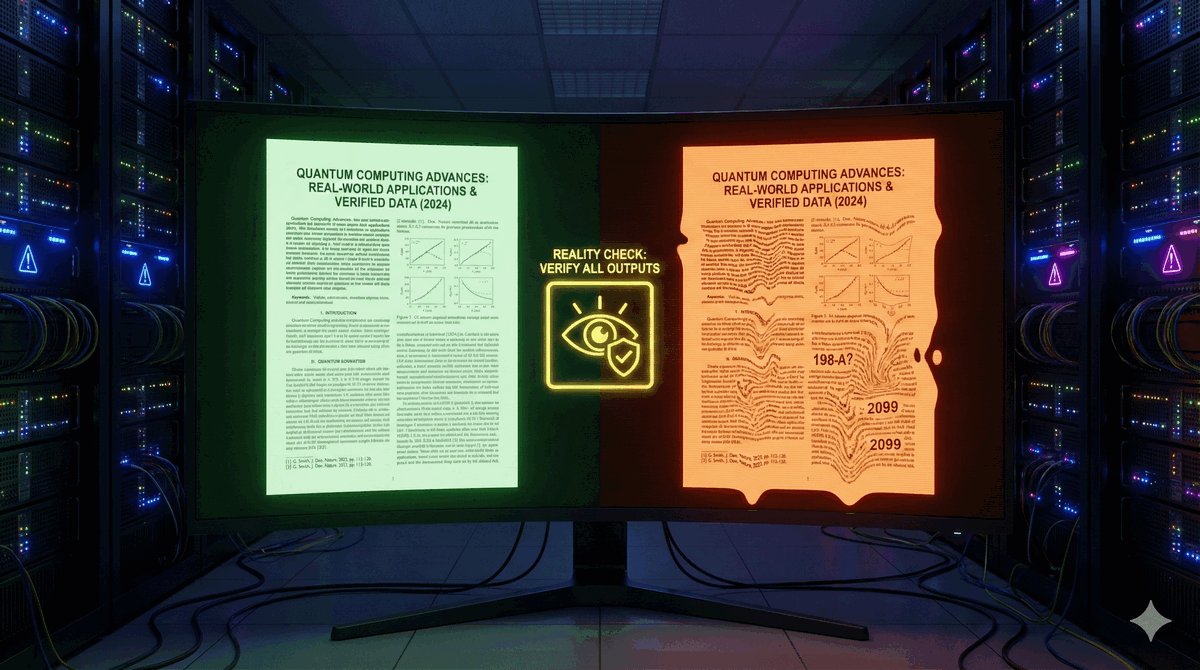

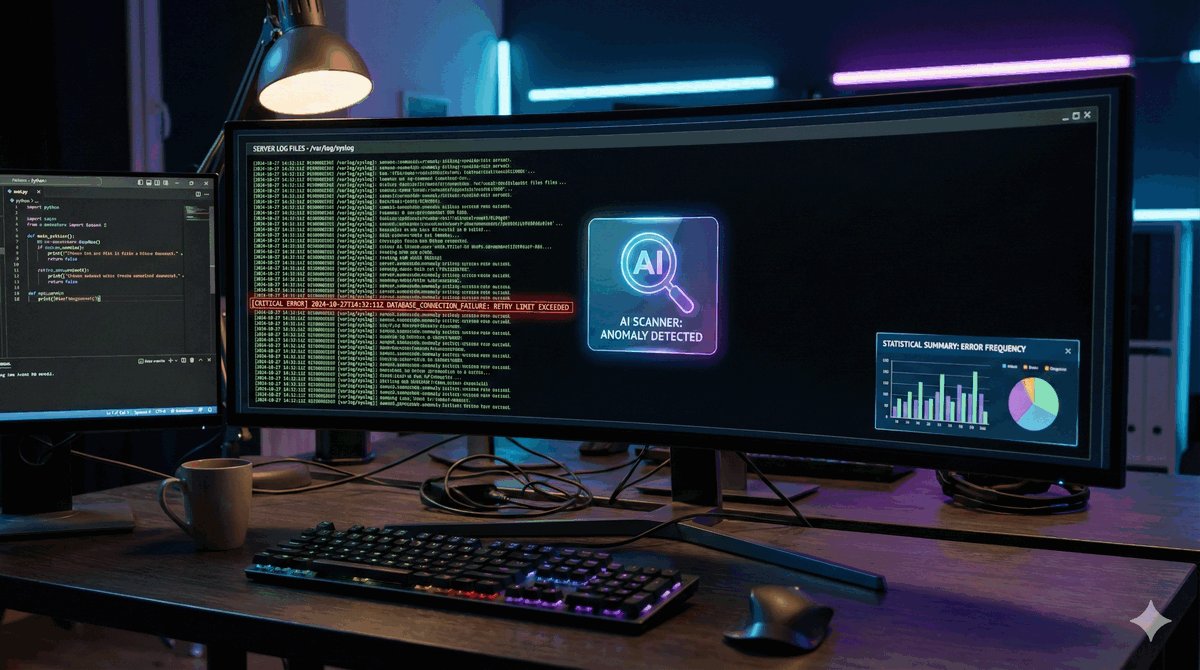

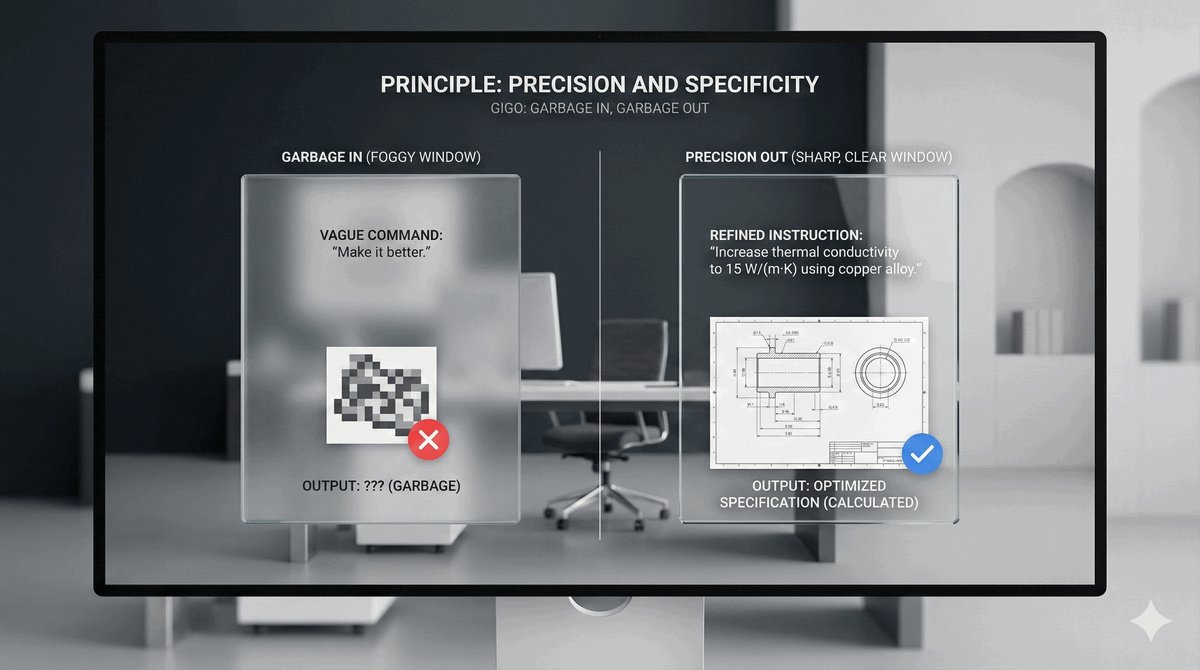

Zamiast traktować AI jako magiczną czarną skrzynkę, nauczymy się obsługiwać ją jak precyzyjne narzędzie inżynierskie.

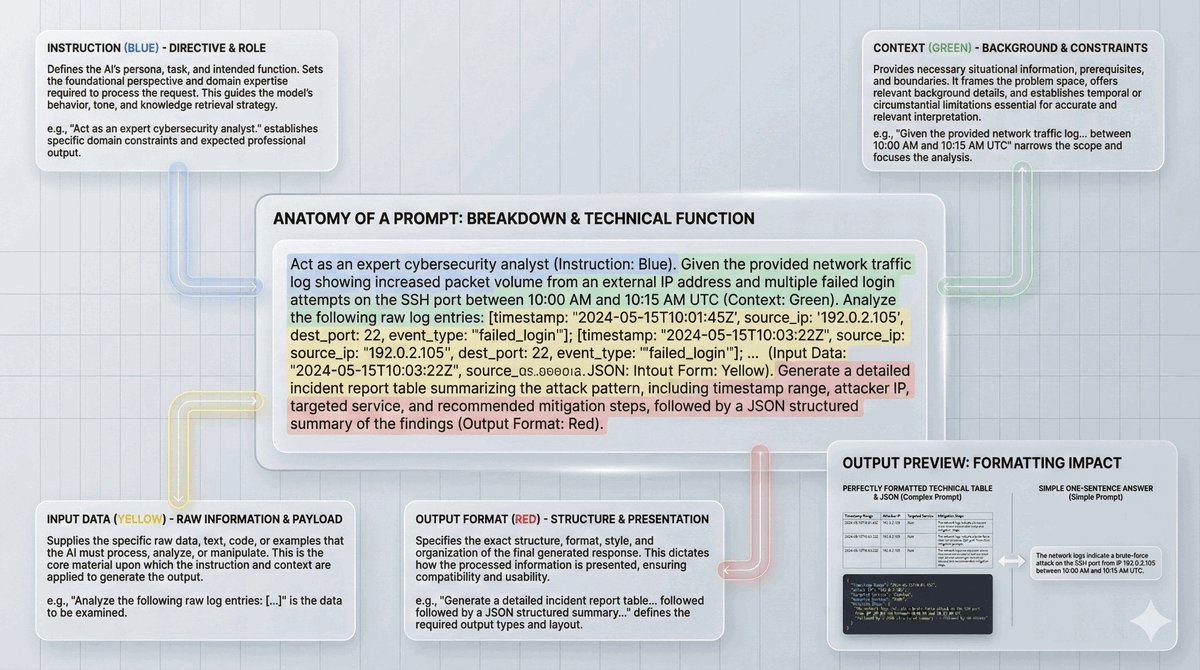

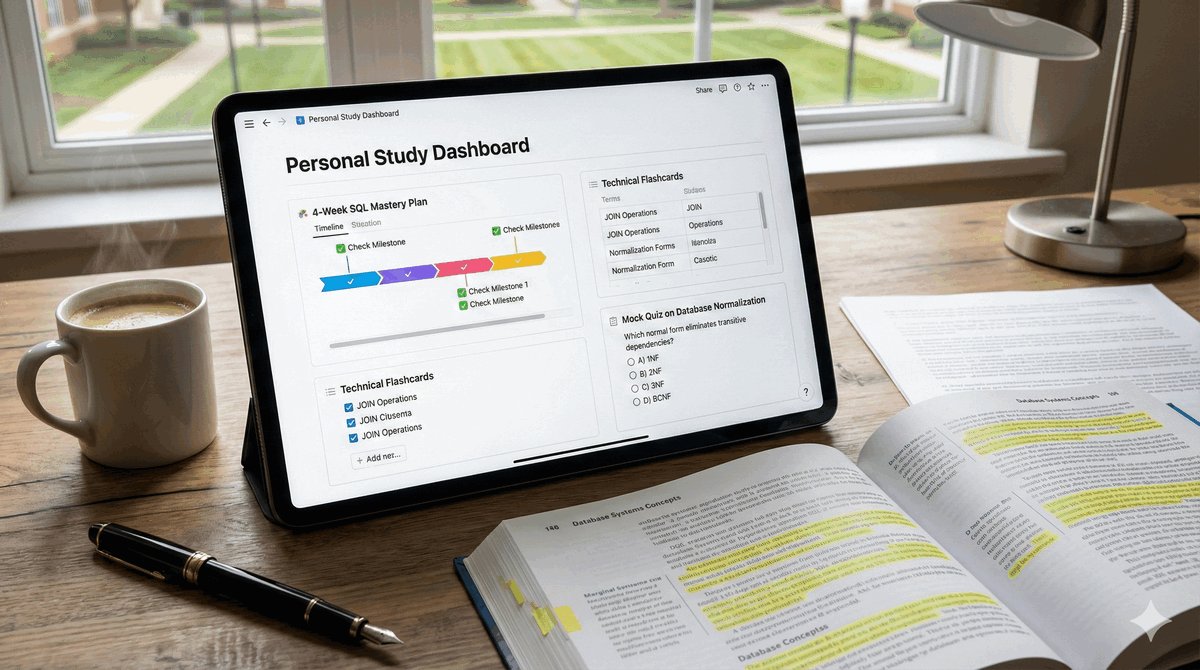

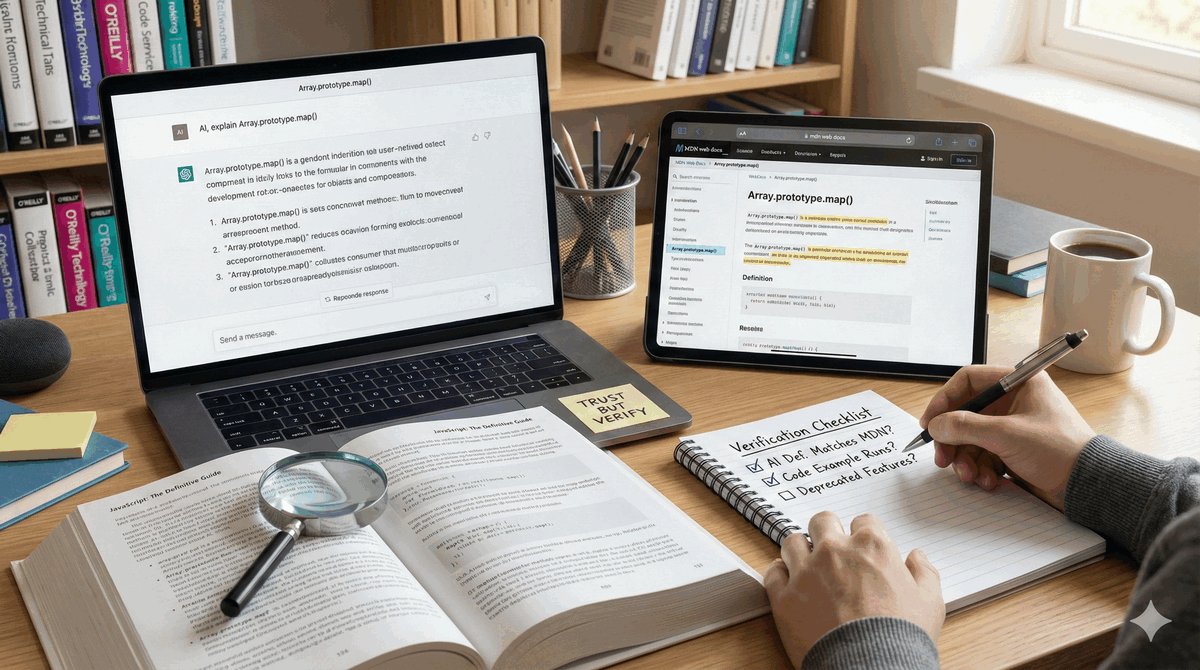

- Cel: Zrozumienie mechanizmów stojących za odpowiedziami AI.

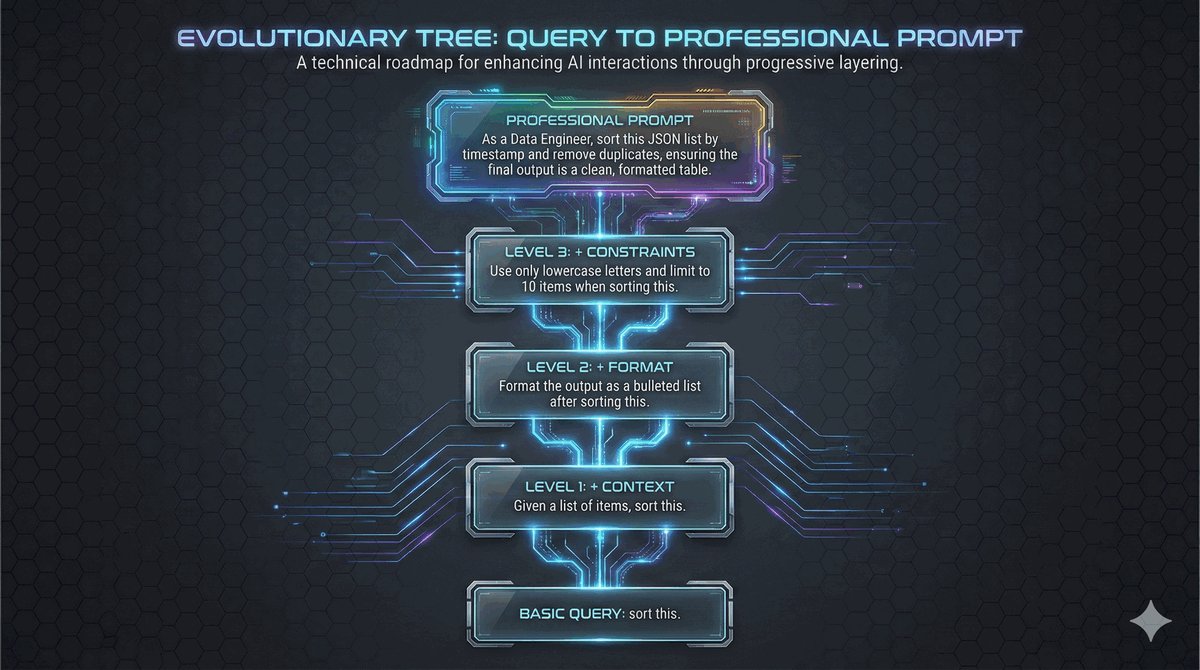

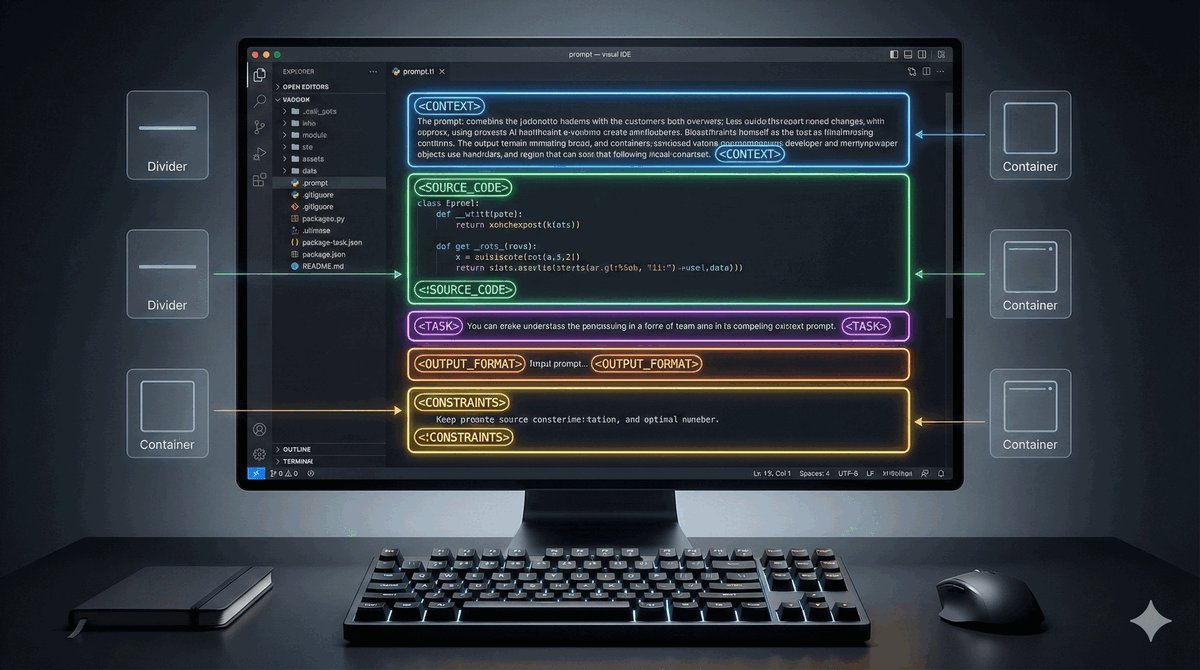

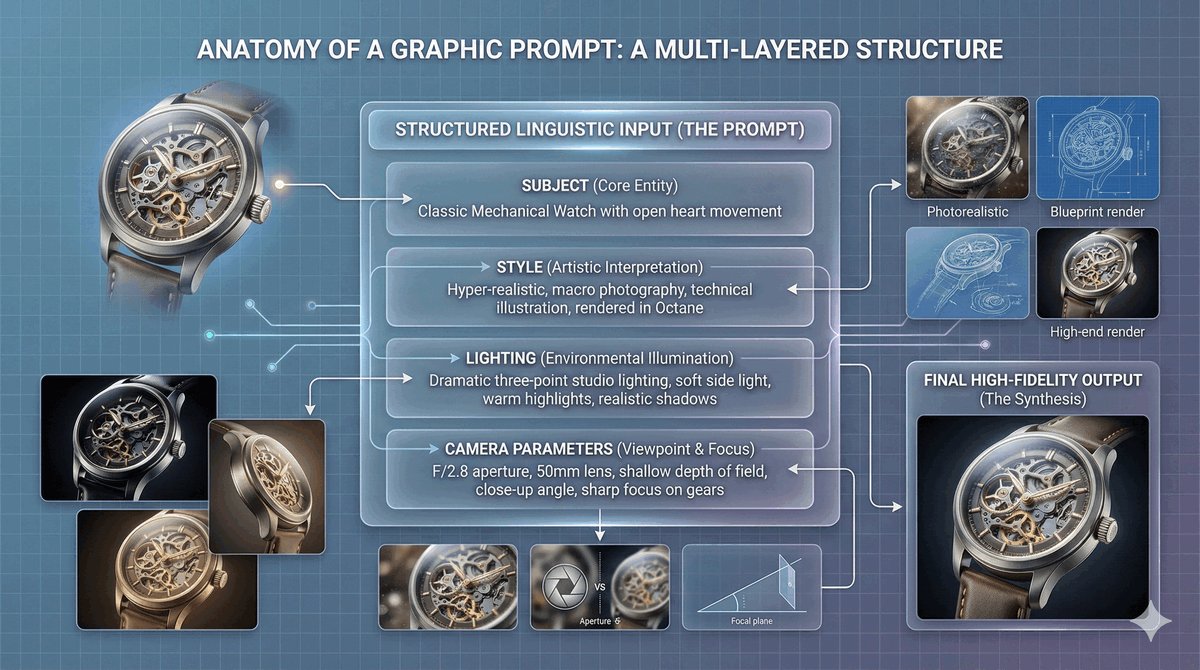

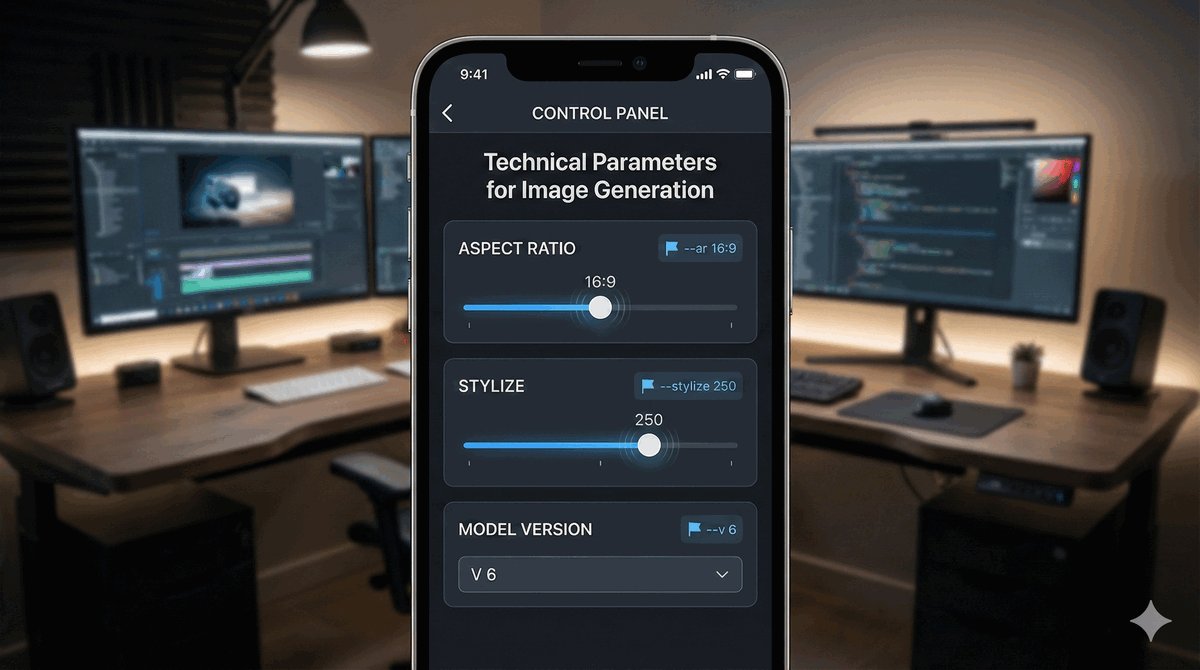

- Metoda: Nauka konstruowania skutecznych poleceń (promptów).

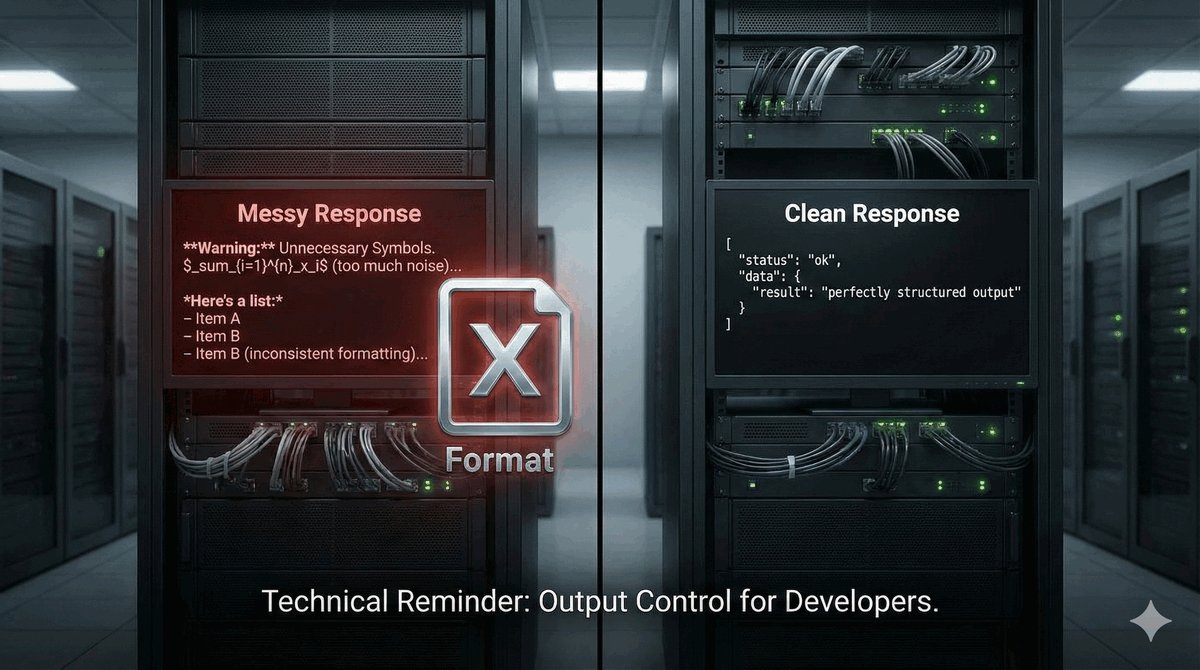

- Efekt: Szybsza nauka, lepsze kody i wysokiej jakości materiały.